随着人工智能技术的飞速发展,以ChatGPT为代表的大语言模型(LLMs)正逐步渗透到网络安全领域,为恶意软件分析带来了前所未有的变革。作为人工智能基础软件开发的重要组成部分,如何有效整合这些先进模型,提升分析效率与准确性,已成为当前研究与实践的热点。

一、ChatGPT在恶意软件分析中的应用场景

- 代码理解与注释生成:恶意软件常采用混淆、加密等手段隐藏其意图。ChatGPT能够快速解析代码片段,生成清晰注释,帮助分析人员理解其功能逻辑,如识别系统调用、网络通信行为或文件操作。

- 行为模式识别:通过输入恶意软件的动态行为日志(如API调用序列),ChatGPT可其攻击模式(如勒索软件加密文件、后门建立持久化访问),辅助分类与溯源。

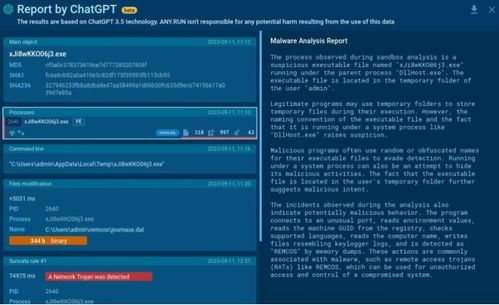

- 报告自动化生成:分析人员可将逆向工程结果输入ChatGPT,自动生成结构化的分析报告,包括威胁指标(IOCs)、危害评估及缓解建议,大幅节省人力成本。

- 漏洞关联分析:结合漏洞数据库,ChatGPT能帮助关联恶意软件利用的漏洞类型,预测潜在攻击趋势,为防御策略提供参考。

二、人工智能基础软件开发的整合路径

在开发面向恶意软件分析的AI工具时,需注重以下关键环节:

- 数据预处理与增强:构建高质量的恶意软件数据集(如代码样本、行为日志),并通过数据清洗、标签标准化提升模型训练效果。开发专用插件或API,实现与沙箱、逆向工具的无缝对接。

- 模型微调与领域适配:基于开源大模型(如GPT系列),利用安全领域数据对模型进行微调,增强其对专业术语(如“壳代码”“反射注入”)的理解能力,减少误判。

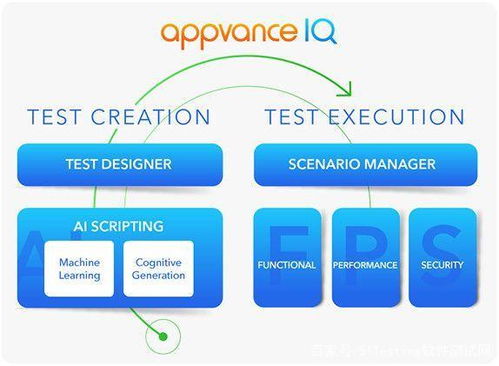

- 交互式分析平台设计:开发可视化界面,允许分析人员通过自然语言与ChatGPT交互,实时查询分析结果,并支持多轮对话以深入探究可疑代码段。

- 安全与伦理约束集成:在软件中内置防护机制,防止模型被滥用(如生成恶意代码),同时确保数据隐私合规,避免敏感信息泄露。

三、挑战与未来展望

尽管前景广阔,但当前应用仍面临诸多挑战:

- 准确性局限:ChatGPT可能产生“幻觉”,输出错误分析结论,需结合传统检测方法(如签名匹配、启发式分析)进行交叉验证。

- 实时性需求:恶意软件变种快速演化,要求模型能低延迟响应。优化推理效率、开发边缘计算方案将成为关键。

- 对抗性攻击风险:攻击者可能针对模型弱点设计对抗样本,未来需研究鲁棒性更强的AI驱动分析框架。

随着多模态AI技术的发展,结合代码、图像(如混淆图形界面)与网络流量的综合分析将成为趋势。人工智能基础软件开发应聚焦于构建模块化、可扩展的恶意软件分析生态系统,推动人机协同防御体系的成熟,为网络安全注入智能动力。